用上Stable Diiffusion首先要感谢B站的 “赛博菩萨” —— 秋葉aaaki。

最新版本v4.6整合包已经整合了很多插件、扩展,基本上做到了开箱即用。

安装Stable-Diffusion

前提条件:内存大于16G、固态硬盘、2060以上的英伟达显卡,低于这个配置未必不能运行但不建议

安装非常简单,首先安装运行依赖dotnet,然后解压缩到非中文、固态硬盘下的目录。

打开启动器.exe,自动安装各种依赖,点击一键启动按钮即可。

下载模型

模型分为很多种,我目前用到的有Stable Diffusion大模型、VAE模型、Lora模型。

模型管理里面可以下载各种模型,包括官方模型和他人训练的模型。

我了解到的官方模型有:Stable-Diffusion V1.5/V2.1/XL;V1.5最通用,有很多适用的Lora;XL更新更强大,也更耗费资源。

下载模型的网址:

https://huggingface.co/stabilityai

下载完成后可以点击添加模型按钮,也可以直接复制到models/目录下,比如VAE模型复制到models/vae

Prompt提示词

启动之后会打开一个网页,选择要使用的模型之后就可以输入Prompt开始绘画了。

Prompt分为正向提示词,反向提示词。用逗号分割,可以用描述性句子也可以每个都是单词。

比如让他画一只小熊猫在树上 1 red panda in the tree

看起来似乎还可以,当然实际上别人出图的时候那些Prompt像咒语一样,可以直接拿别人的提示词来用,复现别人实现的效果,再加加改改大概就知道怎么用了。

来个稍微复杂点的:

2people(1boy and 1girl),walking,(street_background:1.3),(looking at viewer),dynamic pose,dynamic angle,(masterpiece:1.4, best quality),unity 8k wallpaper,ultra detailed,beautiful and aesthetic,perfect lighting,detailed background,realistic, BREAK 1girl,red long hair and red eyes and (red shirt:1.3), BREAK 1boy,yellow short hair and yellow eyes and (yellow suit:1.3) and hands in pocket,

小提示:

-

第一次用先加载基础起手式

-

好用的prompt记得保存下来下次使用,也可以查看之前的历史记录

-

目前支持翻译prompt,以及直接点击选取/删除prompt

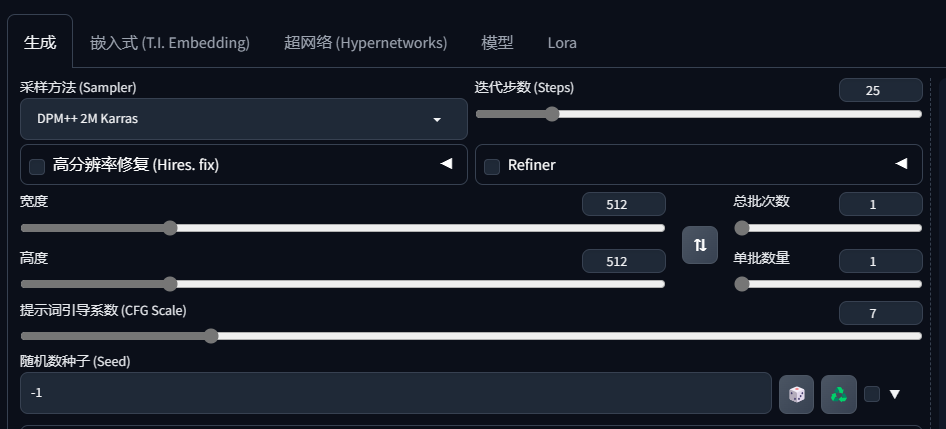

调整参数

首页有一堆参数看着就令人头疼,没用到之前可以不用了解全部参数。

- 采样方法:影响出图画质,推荐DPM++ 2M Karras / DPM++ SDE Karras /Euler、Euler A

- 迭代步数: 20-30

- 宽度和高度:图片分辨率,不宜太高,一般宽度小于800,可以用高清修复

- 高清修复:放大算法推荐 R-ESRGAN 4X+ Anime6B(动漫风格) / 4x UltraSharp(真实风格)

- 提示词相关性: 也很好理解,一般7-10+

- 总批次和单批数量:多图尽量选择增加总批次

- 随机数种子:-1随机,具体的种子可以用来复现结果

总结

有了整合包和各种模型的帮助下,我们已经能够快速安装好Stable-Diffusion以及开始绘图了。不过想要出到稳定的图片,还有很多事情要学习:比如选择正确的大模型、输入准确的提示词、合理的分辨率、采样方法、迭代次数等参数、搭配合理的VAE、Lora模型,都能让绘画更加精准和精致。

当然我也在不断学习的过程中,建议大家可以多去看看别人训练的模型、别人画好的作品,拿来学习模仿。